物理シミュレーションを使った映像がステキ。レンダリングも綺麗。

参考資料

“Lessons in Chemistry” Main Title

Apple TV+で配信してるドラマのタイトル映像らしい。鉛筆の動きや映像の雰囲気がいいです。

IRREGULAR

点滅は目がやられそうですが、点群とシミュレーションの組み合わせは面白そう。

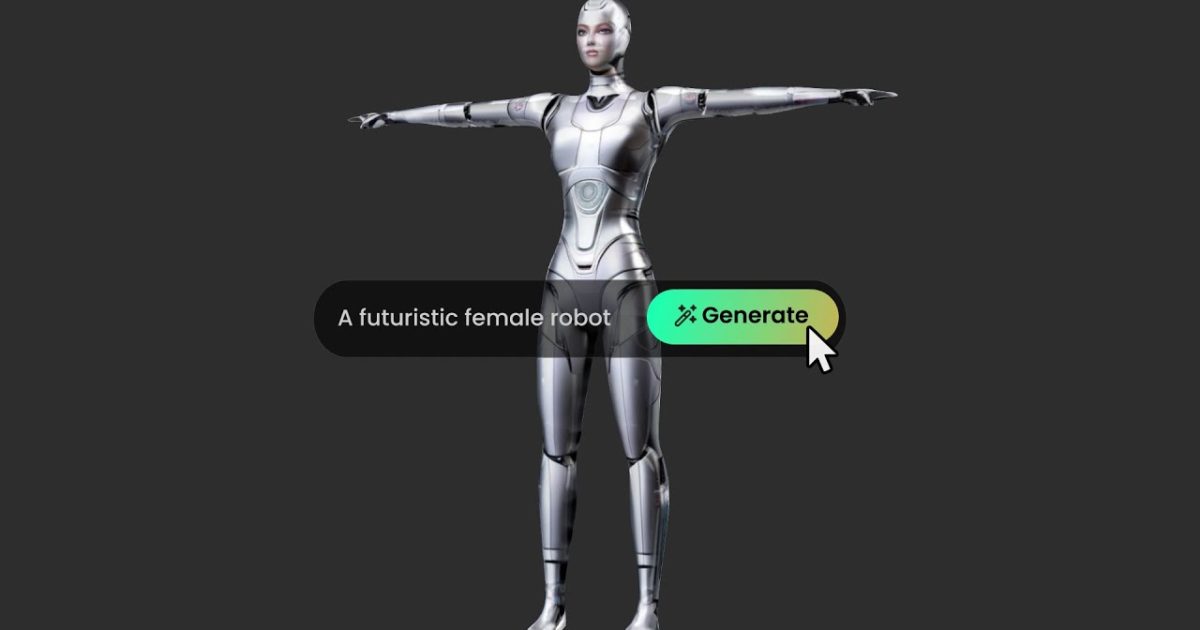

text-to-3D サービス「Masterpiece X – Generate」

text-to-3D サービス「Masterpiece X – Generate」が公開されたようです。NVIDIA の Picasso を使用してるらしい。 ブログが同じことを何度も叫んでたり、画像クリックが全て別ペー […]

弐瓶 勉×ポリゴン・ピクチュアズ最新作となる『大雪海のカイナ ほしのけんじゃ』メイキング

映画『大雪海のカイナ ほしのけんじゃ』のメイキング記事が公開されています。 https://cgworld.jp/article/2310-ooyukiumi01.html https://cgworld. […]

ActionVFX が無料の練習映像ライブラリを公開

ActionVFX が無料の500以上の高品質練習映像ライブラリを公開しました。2KのMP4、ProRes ファイルです。 ActionVFXの映像ライブラリは『アベンジャーズ/エンドゲーム』『ストレンジャー・シングス』 […]

LightWave 3D User Event October 6, 2023

11月にリリースを予定している LightWave 2023 の機能や、今後の計画を紹介するユーザーイベントのビデオが公開されています。 LightWave 2023リリースに向けた今後の機能や計画を紹介す […]

Lightwave 3D Anime Reel 2023

Lightwaveを使用して制作された日本のアニメを集めたリールが公開されています。

『FINAL FANTASY XVI』メイキング

『FINAL FANTASY XVI』のメイキング記事が公開されています。 https://cgworld.jp/article/202309-cgw301-ff16-01.html https://cgworld.jp […]

Nike NSRL Recovery Kit R&D

布のシミュレーションと質感が綺麗です。

VTS - ACCELERATE

カールノイズ好き。レンダリングも綺麗ですね。

2DFX demoreel oleg volotovski

海外の2Dアニメの撮影処理。日本のアニメとコンポジットと似てるけどさじ加減が違ってて面白い。

AAA Terrains

Boonar Studio のツール開発部分である Boonika Art Tools が「AAA Terrains」をリリースしました。Pro バージョンには、ハイトマップとカラー テクスチャのセットに加えて、Eros […]

細部までこだわったメカや空戦が見どころ『劇場版 PSYCHO-PASS サイコパス PROVIDENCE』

『劇場版 PSYCHO-PASS サイコパス PROVIDENCE』のメイキング記事が公開されています。 https://cgworld.jp/article/202308-psycho-pass-01.html htt […]

Golden Era

「日本の(ポップ)カルチャーと伝統へのオマージュ」した映像作品とのことです。海外で「金継ぎ」は以外と知名度があって、金継ぎをモチーフにした靴や服が発売されてるという話を見かけましたが、本当に知られてるんだと思った。