粘土細工のようなモデルがかわいくていいですね。

Diary

The Lost Chapter: Yuki’s Revenge | Fortnite After Dark

『キル・ビル』のスピンオフ?『ユキの復讐』のメイキング記事が公開されています。単純にコマ抜いてるのか、だいぶカクカクした印象ですね。 タランティーノ監督が撮影現場で俳優に指示を出しながら、フォートナイト内でリアルタイムに […]

External Clipboard for Modo

ModoとBlender間でメッシュをコピペできるようになる「External Clipboard for Modo」が公開されました。 BlenderのFBXインポーターはかなりダメダメで、選択セットのインポートに対応 […]

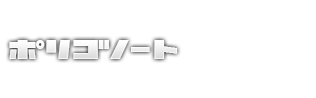

Gaea 3 発表

地形生成ソフト「Gaea 3」が発表されました。正式リリースは2026年半ばの発売を予定しているとのことです。 サイトのサンプルが綺麗でいいですね。安定性に問題があるという話を見かけますが、どうなんでしょう。 https […]

Delta-Cast

何これカッコイイ。ギプスを切断する機械らしいです。

シーン内のすべてのオブジェクトから頂点カラーマップを削除するmodoスクリプト

MrUzuさんが、シーン内のすべてのオブジェクトから頂点カラーマップを削除するスクリプトを公開しています。 シンプルなコードなので、他のVmapの編集スクリプトの参考になりそうです。 https://discord.co […]

AMD FSR Redstone とニューラルレンダリングの未来

AMD FSR Redstone SDKが公開されました。機械学習ベースのアップスケーリング、フレーム生成、レイ生成、ラディアンスキャッシュが追加されたようです。フレーム生成では前後フレームと整合性を取るため、深度とモー […]

ZBrush 2026.1とZBrush for iPad 2026.1 リリース

ZBrush 2026.1とZBrush for iPad 2026.1がリリースされました。 https://www.maxon.net/ja/zbrush#whats-new https://support.maxo […]

Cinema 4D 2026.1 リリース

Cinema 4D 2026.1 リリースがリリースされました。自動でスケールするアドバンス分布が面白いですね。 Cinema 4Dは毎回新機能の情報が色々分散していて、何処を見れば新機能の画像や動画を確認できるかわから […]

Mustang

質感が綺麗でカッコイイ

Guerlain Les Conte Des Merveilles

折り紙ストップモーション風の香水のCM。紙のように白色単色だとライティングや見ばえのする絵にするのが難しかったりしますが、シェーディングが綺麗に仕上がってます。

BR1X-REEL GAME2025

中華系ソシャゲのPVなのかな?実写からゲームキャラへの切り替えが、昔のゲームのCMみたいで面白い。エフェクトのクオリティも高いですね。

Papadopoulos - Christmas TVC - IXOR Digital

海外の古き良きクリスマスCMの雰囲気ですね。AI使用CMっぽいです。サイトを見ると、大手企業のCMを手がけてる印象です。

Kelvin Sculpt tools for Modo

Kelvin Sculpt tools for Modoがリリースされました。PixarのKelvinlets(2017)変形モデルをModoに直接組み込んだスカルプトツールです。 わりと軽く動作しますね。メッシュ全体に […]

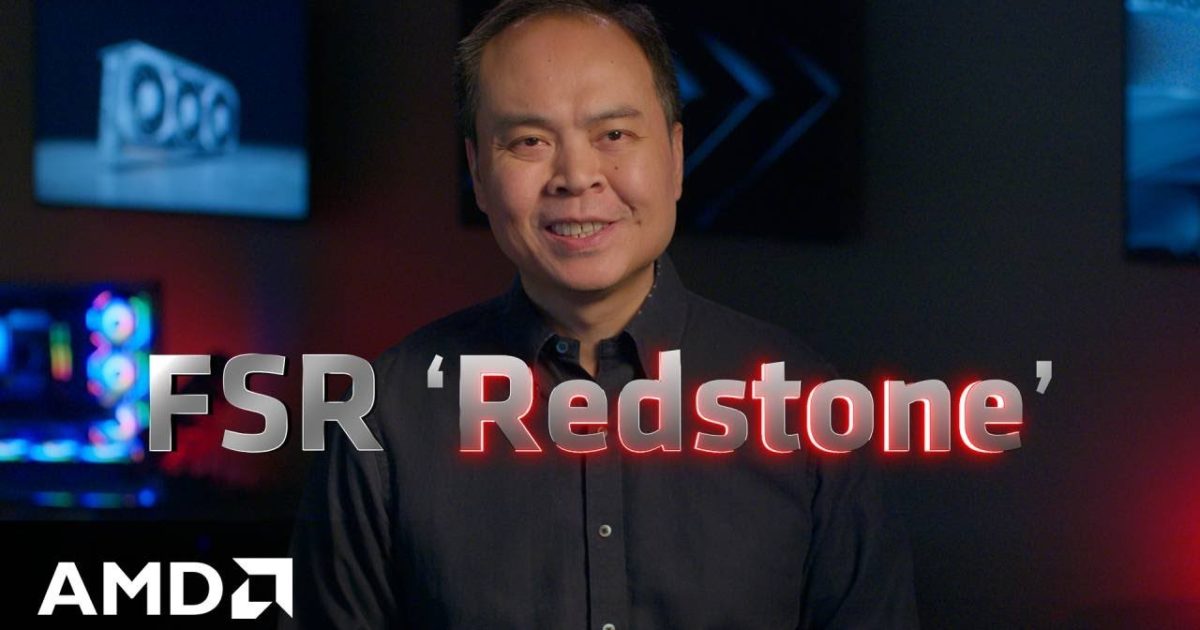

Mesh Approximation tools for Modo

Mesh Approximation tools for Modoがリリースされました。サーフェースポリゴンを三角メッシュで近似するツールのようです。 物理演算のコリジョンモデル生成に使えそうですね。私の環境だとクラッシ […]